ഓപ്പൺഎഐ ചാറ്റ്ജിപിടി സമാരംഭിച്ചതു മുതൽ ലോകമെമ്പാടും ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് ഒരു പ്രധാന വാക്കാണ്. ലോകമെമ്പാടുമുള്ള ആളുകൾ അവരുടെ ദൈനംദിന ജീവിതത്തിൽ AI ചേർത്തിട്ടുണ്ടെങ്കിലും, ഓരോ നാണയത്തിനും ഒരു മറുവശമുണ്ട്, AI യുടെ കാര്യത്തിലും ഇത് സത്യമാണ്. ഇതിന് ന്യായമായ ആനുകൂല്യങ്ങൾ ഉണ്ട്, എന്നാൽ ചില ഭയാനകമായ ഉപയോഗങ്ങൾക്കും ഇത് ഉപയോഗിച്ചിട്ടുണ്ട്. റിപ്പോർട്ടുകൾ പ്രകാരം, ആളുകളെ പല തരത്തിൽ കബളിപ്പിക്കാൻ ആളുകൾ AI ദുരുപയോഗം ചെയ്യുന്നു. ഡീപ്ഫേക്കുകൾ സൃഷ്ടിക്കുന്നത് മുതൽ അവരുടെ സുഹൃത്തുക്കളെയും കുടുംബാംഗങ്ങളെയും അനുകരിക്കുന്നതിനായി ഒരു വ്യക്തിയുടെ ശബ്ദം ക്ലോൺ ചെയ്യുന്നത് വരെ ഇത് ഒരു പ്രധാന ആശങ്കയായി മാറിയിരിക്കുന്നു.

ആളുകളെ കുടുക്കാൻ സ്കാമർമാർ തിരഞ്ഞെടുക്കുന്ന ഒരു സാധാരണ മാർഗമാണ് AI ഡീപ്ഫേക്കുകൾ. 2023-ൽ ഇന്ത്യയിൽ AI വ്യാപകമായി ആക്സസ് ചെയ്യാവുന്ന ജനറേറ്റീവ് AI ടൂളുകൾ ഇമേജുകൾ, ഓഡിയോ, വീഡിയോകൾ എന്നിവയുടെ രൂപത്തിൽ ഡീപ്ഫേക്കുകൾ സൃഷ്ടിക്കാൻ പ്രാപ്തമാക്കി. ഇതിനകം പാർശ്വവൽക്കരിക്കപ്പെട്ട ഗ്രൂപ്പുകളെയും കമ്മ്യൂണിറ്റികളെയും ലക്ഷ്യം വയ്ക്കുന്നതിനാണ് ഈ സാങ്കേതികവിദ്യ പ്രധാനമായും ഉപയോഗിച്ചിരിക്കുന്നത്. 2017 മുതൽ ഡീപ്ഫേക്കുകളെ ചുറ്റിപ്പറ്റിയുള്ള ബഹളം നിലവിലുണ്ടെങ്കിലും, ഈ വർഷം ഇന്ത്യയിലെ വസ്തുതാ പരിശോധകർ പ്രാദേശിക പ്രേക്ഷകർക്ക് അനുയോജ്യമായ സിന്തറ്റിക് ഉള്ളടക്കവും ഹിന്ദിയിൽ AI വോയ്സ് ക്ലോണുകളും കണ്ടു – ഇത് മുമ്പ് കണ്ടിട്ടില്ലാത്ത ഒരു പ്രതിഭാസം.

ആളുകളെ കുടുക്കാൻ സ്കാമർമാർ തിരഞ്ഞെടുക്കുന്ന ഒരു സാധാരണ മാർഗമാണ് AI ഡീപ്ഫേക്കുകൾ. 2023-ൽ ഇന്ത്യയിൽ AI വ്യാപകമായി ആക്സസ് ചെയ്യാവുന്ന ജനറേറ്റീവ് AI ടൂളുകൾ ഇമേജുകൾ, ഓഡിയോ, വീഡിയോകൾ എന്നിവയുടെ രൂപത്തിൽ ഡീപ്ഫേക്കുകൾ സൃഷ്ടിക്കാൻ പ്രാപ്തമാക്കി. ഇതിനകം പാർശ്വവൽക്കരിക്കപ്പെട്ട ഗ്രൂപ്പുകളെയും കമ്മ്യൂണിറ്റികളെയും ലക്ഷ്യം വയ്ക്കുന്നതിനാണ് ഈ സാങ്കേതികവിദ്യ പ്രധാനമായും ഉപയോഗിച്ചിരിക്കുന്നത്. 2017 മുതൽ ഡീപ്ഫേക്കുകളെ ചുറ്റിപ്പറ്റിയുള്ള ബഹളം നിലവിലുണ്ടെങ്കിലും, ഈ വർഷം ഇന്ത്യയിലെ വസ്തുതാ പരിശോധകർ പ്രാദേശിക പ്രേക്ഷകർക്ക് അനുയോജ്യമായ സിന്തറ്റിക് ഉള്ളടക്കവും ഹിന്ദിയിൽ AI വോയ്സ് ക്ലോണുകളും കണ്ടു – ഇത് മുമ്പ് കണ്ടിട്ടില്ലാത്ത ഒരു പ്രതിഭാസം.

AI ഇമേജുകൾ മികച്ചതും മെച്ചപ്പെട്ടതുമാണ്

ഈ വർഷം മെയ് മാസത്തിൽ പോലീസ് വാനിനുള്ളിൽ തടങ്കലിലായപ്പോൾ പ്രതിഷേധിക്കുന്ന ഏതാനും ഇന്ത്യൻ ഗുസ്തിക്കാർ പുഞ്ചിരിക്കുന്ന ഫോട്ടോ സോഷ്യൽ മീഡിയയിൽ വൈറലായിരുന്നു.ഗുസ്തി ഫെഡറേഷൻ ഓഫ് ഇന്ത്യയുടെ മുൻ തലവനും ഭാരതീയ ജനതാ പാർട്ടി എംപിയുമായ ബ്രിജ് ഭൂഷൺ സിങ്ങിനെതിരെ ലൈംഗികാരോപണം ഉന്നയിച്ചാണ് ഗുസ്തിക്കാർ പ്രതിഷേധിച്ചത്. എന്നിരുന്നാലും, ഫോട്ടോയിലെ കായികതാരങ്ങളുടെ മുഖത്ത് കൃത്രിമമായി പുഞ്ചിരി ചേർത്തുകൊണ്ട് ഫേസ് ആപ്പ് എന്ന എഐ ഫോട്ടോ എഡിറ്റിംഗ് ആപ്പ് ഉപയോഗിച്ചാണ് ചിത്രം ചെയ്തത്.

AI-യെ അടിസ്ഥാനമാക്കിയുള്ള തെറ്റായ വിവരങ്ങൾ AI-യുടെ ബൈനറികളിലേക്കും അല്ലാത്തതിലേക്കും എങ്ങനെ വീഴുന്നില്ല എന്നും, വിശാലമായ സ്പെക്ട്രത്തിന് ഇടയിൽ എവിടെയെങ്കിലും വീഴുന്ന അത്തരം കൃത്രിമങ്ങൾ പിടിക്കാൻ നിലവിലെ കണ്ടെത്തൽ ഉപകരണങ്ങൾ സജ്ജീകരിച്ചിട്ടില്ലെന്നും ഈ സംഭവം കാണിച്ചുതന്നു.

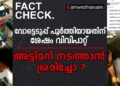

മെയ് മാസത്തിൽ പെന്റഗണിലെ സ്ഫോടനം കാണിക്കാൻ പൂർണ്ണമായി AI സൃഷ്ടിച്ച ഫോട്ടോ യുഎസ് സ്റ്റോക്ക് മാർക്കറ്റുകളെ ഹ്രസ്വമായി ഇടിയാൻ കാരണമായി. നിരവധി ഇന്ത്യൻ മുഖ്യധാരാ വാർത്താ ഏജൻസികളും ഈ തട്ടിപ്പ് നടത്തിയിരുന്നു. കിംവദന്തികൾ പ്രചരിപ്പിക്കാനും പരിഭ്രാന്തരാകാനും സാമ്പത്തിക വിപണികളെ ഇളക്കിവിടാനും AI സൃഷ്ടിച്ച തെറ്റായ വിവരങ്ങൾ എങ്ങനെ ഉപയോഗിക്കാമെന്ന് ഈ സംഭവം കാണിച്ചുതന്നു.

വീടിനടത്ത് ഈ വർഷത്തെ ഇന്ത്യയിലെ ഏറ്റവും വലിയ വാർത്തകളിൽ ഒന്ന് AI സൃഷ്ടിച്ച ചിത്രം ഉപയോഗിച്ചു. ഇസ്രായേൽ-ഹമാസ് യുദ്ധത്തിന്റെ പശ്ചാത്തലത്തിൽ സിന്തറ്റിക് ചിത്രങ്ങളും പങ്കുവെച്ചിട്ടുണ്ട്. തകർന്ന കെട്ടിടങ്ങൾക്കിടയിൽ തന്റെ അഞ്ച് കുട്ടികളുമായി ഒരാൾ നടക്കുന്നതായി കാണിക്കുന്ന ഒരു ചിത്രം, AI സൃഷ്ടിച്ചതാണെന്ന് തെളിഞ്ഞു.

ഗാസയിലെ സിവിലിയൻ ജനതയുടെ കഷ്ടപ്പാടുകളെ തുരങ്കം വയ്ക്കാൻ പലപ്പോഴും ഉപയോഗിച്ചിരുന്നതിനാൽ അത്തരം ചിത്രങ്ങളുടെ ഉപയോഗം അപ്രതീക്ഷിതമായ പ്രത്യാഘാതങ്ങൾ ഉണ്ടാക്കുന്നു. AI ചിത്രങ്ങൾക്കൊപ്പം, ഇസ്രായേൽ-ഹമാസ് യുദ്ധത്തെക്കുറിച്ച് തെറ്റായ വിവരങ്ങൾ പ്രചരിപ്പിക്കാൻ AI വോയ്സ് ക്ലോണുകളും ഉപയോഗിച്ചിട്ടുണ്ട്.

ഇസ്രായേലി ശബ്ദ ഡിസൈനറെയും വോയ്സ് ഓവർ ആർട്ടിസ്റ്റിനെയും പിന്നീട് കണ്ടെത്തി. AI വോയ്സ് ക്ലോണിംഗ് സാങ്കേതികവിദ്യ ഉപയോഗിച്ച് ജോർദാനിലെ റാനിയ രാജ്ഞി, മുൻ മുതിർന്ന ചലച്ചിത്ര നടി മിയ ഖലീഫ, സംഗീതജ്ഞൻ റോജർ വാട്ടേഴ്സ്, നടി ആഞ്ജലീന ജോളി തുടങ്ങിയവരുടെ ഡീപ്ഫേക്കുകൾ സൃഷ്ടിച്ചു.

ഈ വർഷം യുഎസ് പ്രസിഡന്റ് ജോ ബൈഡൻ, ഉക്രെയ്ൻ പ്രസിഡന്റ് വോളോഡിമർ സെലെൻസ്കി, മൈക്രോസോഫ്റ്റ് സഹസ്ഥാപകനും മനുഷ്യസ്നേഹിയുമായ ബിൽ ഗേറ്റ്സ് എന്നിവരെ ലക്ഷ്യമിട്ടുള്ള നിരവധി ഡീപ്ഫേക്ക് വീഡിയോകളും ഫേക്ക് ആണെന്ന് തെളിഞ്ഞു.

തട്ടിപ്പ് നടത്താൻ AI വോയ്സ് ക്ലോണുകളും ഉപയോഗിക്കുന്നു. ഇന്ത്യയിൽ, വഞ്ചനാപരമായ സമ്പന്നരാകാനുള്ള സ്കീമുകൾക്കായി കോൺ ആർട്ടിസ്റ്റുകൾ സെലിബ്രിറ്റികളുടെ AI വോയ്സ് ക്ലോണുകൾ ഉപയോഗിക്കുന്നു.

വഞ്ചനാപരമായ നിക്ഷേപ പദ്ധതികളും വ്യാജ ഉൽപ്പന്നങ്ങളും പ്രചരിപ്പിക്കുന്ന ജനപ്രിയ ഇന്ത്യൻ സെലിബ്രിറ്റികളുടെ AI വോയ്സ് ക്ലോണുകൾ ഉപയോഗിച്ച് ഫെയ്സ്ബുക്ക് തട്ടിപ്പ് പരസ്യങ്ങളാൽ നിറഞ്ഞിരിക്കുന്നതായി കണ്ടെത്തി.

ഷാരൂഖ് ഖാൻ, വിരാട് കോഹ്ലി, മുകേഷ് അംബാനി, രത്തൻ ടാറ്റ, നാരായണ മൂർത്തി, അക്ഷയ് കുമാർ, സദ്ഗുരു എന്നിവരുടെ AI വോയ്സ് ക്ലോണുകളുള്ള തട്ടിപ്പ് പരസ്യങ്ങൾ ഈ വ്യക്തികളുടെ യഥാർത്ഥ വീഡിയോകളിൽ ഉൾപ്പെടുത്തിയിട്ടുണ്ട്.

അതുപോലെ, വ്യാജ പ്രമേഹ മരുന്ന് പ്രചരിപ്പിക്കുന്നതിനിടയിൽ ഹിന്ദിയിൽ സംസാരിക്കുന്ന അർണബ് ഗോസ്വാമി, രവീഷ് കുമാർ, അഞ്ജന ഓം കശ്യപ്, സുധീർ ചൗധരി തുടങ്ങിയ ജനപ്രിയ ഹിന്ദി ടെലിവിഷൻ വാർത്താ അവതാരകരുടെ AI വോയ്സ് ക്ലോണുകൾ പുറത്തുവന്നു.

ഹിന്ദിയിൽ AI വോയ്സ് ക്ലോണുകളുടെ വർദ്ധനവ് ആശങ്കാജനകമാണ്, 2024 മെയ് മാസത്തിൽ വരാനിരിക്കുന്ന പൊതുതെരഞ്ഞെടുപ്പിൽ ഇത്തരത്തിലുള്ള AI അടിസ്ഥാനമാക്കിയുള്ള രാഷ്ട്രീയ തെറ്റായ വിവരങ്ങളുടെ ഒരു പ്രളയം ഉണ്ടാകുമെന്ന് വസ്തുത പരിശോധിക്കുന്നവർ ഭയപ്പെടുന്നു. 2020 ലെ ഒരു സംസ്ഥാന തിരഞ്ഞെടുപ്പ് പ്രചാരണത്തിൽ ഡീപ്ഫേക്കുകളുടെ ഉപയോഗം ഇന്ത്യ ഇതിനകം കണ്ടിട്ടുണ്ട്.

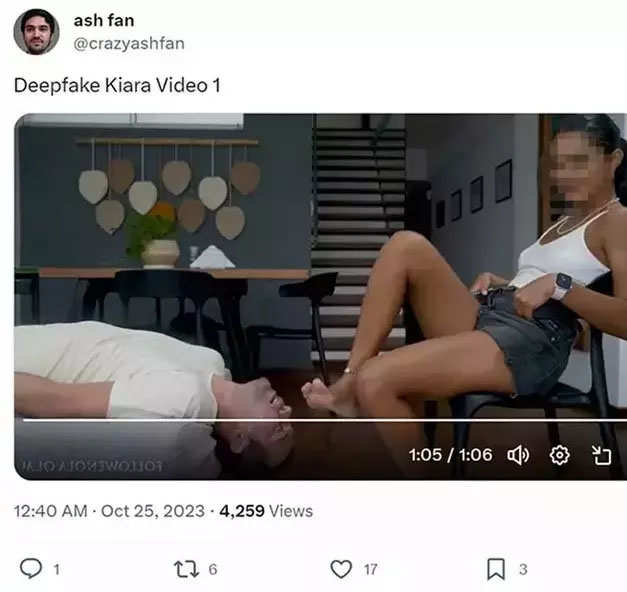

ഡീപ്ഫേക്ക് പോണോഗ്രഫിയുടെ പ്രശ്നകരമായ വർധന

അവസാനമായി, ജനറേറ്റീവ് AI-യുടെ ഏറ്റവും പ്രശ്നകരമായ ഒരു കാര്യം ഡീപ്ഫേക്ക് പോണോഗ്രാഫിയുടെ രൂപത്തിൽ സമ്മതമില്ലാത്ത ഇമേജറി സൃഷ്ടിക്കുന്നതിൽ അതിന്റെ പങ്ക് ആയിരുന്നു.

ഇന്ത്യൻ നടിമാരുടെ മുഖം ഉപയോഗിച്ച് നിർമ്മിച്ച മുപ്പതിലധികം അശ്ലീല വീഡിയോകൾ @crazyashfans എന്ന X ഉപയോക്താവ് പോസ്റ്റ് ചെയ്തതായി കണ്ടെത്തി. എന്നിരുന്നാലും, ഇന്ത്യൻ നടിമാരെ ലക്ഷ്യമിട്ട് ഡീപ്ഫേക്ക് ചിത്രങ്ങളും വീഡിയോകളും പോസ്റ്റ് ചെയ്യുന്ന അത്തരം നിരവധി അക്കൗണ്ടുകൾ എക്സിലും ഫേസ്ബുക്ക്, ഇൻസ്റ്റാഗ്രാം, യൂട്യൂബ് തുടങ്ങിയ മറ്റ് പ്ലാറ്റ്ഫോമുകളിലും നിലവിലുണ്ട്. കൂടാതെ, വ്യക്തിയുടെ ഒരു ഫോട്ടോ മാത്രം അപ്ലോഡ് ചെയ്ത് ഒരാളെ കൃത്രിമമായി ‘സ്ട്രിപ്പ്’ ചെയ്യാൻ ഉപയോക്താക്കളെ അനുവദിക്കുന്ന വെബ്സൈറ്റുകളും ആപ്പുകളും നിലവിലുണ്ട്.

AI ഇമേജ് ജനറേഷനും വോയ്സ് ക്ലോണിംഗ് ടൂളുകളും തിടുക്കത്തിൽ പുറത്തിറക്കിയിട്ടുണ്ടെന്നും അവയുടെ നിലവിലുള്ള ഗാർഡ്റെയിലുകൾ മറികടക്കാൻ എളുപ്പമാണെങ്കിൽ അത് മേൽപ്പറഞ്ഞ സംഭവങ്ങൾ കാണിക്കുന്നു.

ദീർഘകാല ആഘാതം പൂർണ്ണമായി മനസ്സിലാക്കാതെ തങ്ങളുടെ ഉൽപ്പന്നങ്ങളിൽ AI ഫീച്ചറുകൾ അവതരിപ്പിക്കാൻ തിടുക്കം കൂട്ടുന്ന സോഷ്യൽ മീഡിയ പ്ലാറ്റ്ഫോമുകളിൽ നിന്ന് സാങ്കേതികവിദ്യയും കൂടുതൽ ഉത്തരവാദിത്തവും നേടുന്നതിന് നിലവിലുള്ള നിയമങ്ങൾ പരിഷ്ക്കരിക്കുക, AI സാക്ഷരത എന്നിവയാണ് ഈ കാലഘട്ടത്തിന്റെ ആവശ്യം.